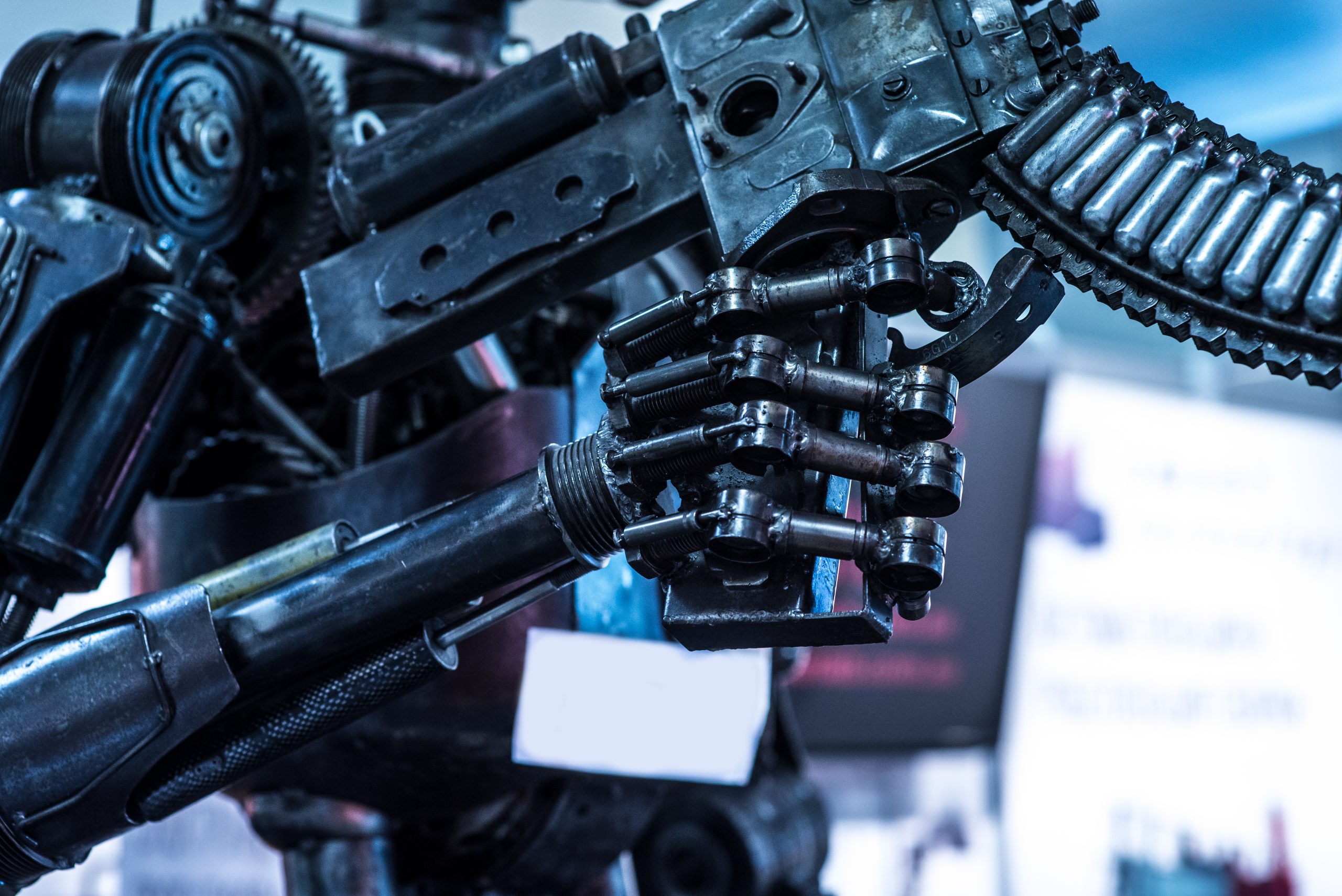

L’utilizzo di robot killer autonomi, fino a pochi anni fa sembrava far parte di un sogno distopico, ad oggi invece sembra essere sempre più parte della nostra realtà.

Questi robot militari, potenzialmente in grado di sostituirsi ai soldati sul campo di battaglia, sono dotati di intelligenza artificiale e di capacità decisionali autonome. Secondo il Dipartimento della Difesa americano, entro il 2050 gli eserciti saranno formati quasi esclusivamente da robot killer capaci quindi di selezionare e colpire obiettivi senza l’intervento decisionale umano.

Sull’impiego dei robot killer gli scienziati si dividono: per alcuni siamo di fronte a un’autentica rivoluzione bellica (la terza dopo l’invenzione della polvere da sparo e delle armi nucleari) che consentirebbe di ridurre drasticamente le perdite tra i soldati. Secondo altri, invece, l’impiego di soldati robot sarebbe una sciagura e significherebbe autorizzare un uso distorto e pericoloso dell’intelligenza artificiale.

L’utilizzo di armi sempre più autonome ha portato così allo sviluppo di un dibattito internazionale. In maniera particolare, un rapporto pubblicato da Pax analizza lo sviluppo dell’industria bellica soprattutto in relazione all’utilizzo di intelligenza artificiale. Negli ultimi 10 anni infatti, si è registrato un notevole aumento delle compagnie che stanno lavorando a queste tecnologie. Per questo sottolinea la necessità di adottare leggi sul tema prima che queste armi senza controllo umano diventino realtà.

I robot killer sarebbero dunque dotati di capacità decisionali autonome, ma gli interrogativi che sorgono spontanei a molti sono diversi, primi tra tutti: “saranno in grado di distinguere fra soldati e civili?”, “opteranno per azioni spropositate o meno?”.

La cosa più importante secondo Pax, è che queste armi “violerebbero i principi legali ed etici fondamentali, destabilizzando la pace e la sicurezza internazionali”. Inoltre solleva un altro interrogativo importante: la responsabilità giuridica di questi robot killer. Questo interrogativo, strettamente connesso alla reale possibilità di errore, sposta il campo d’azione anche sulla più ampia applicazione del diritto all’intelligenza artificiale.

Pax non è l’unica organizzazione che finora ha cercato di intervenire affinché si adotti una legislazione che impedisca il dilagare di questa tipologia di robot. Già nel 2017 un gruppo di scienziati si è riunito sotto lo slogan della campagna “Stop Killer Robots”, portando il problema davanti all’Onu affinché venisse posto un veto sui robot assassini.